Künstliche Intelligenz schreitet im Bereich der Cybersicherheit der Bundesbehörden rasant voran. Sichern wir es schnell genug?

Während eines kürzlich stattgefundenen FedInsider-Webinars erzählte ich eine Geschichte, die ich gehört hatte und die mir immer noch zu denken gibt.

Ein CIO der Bundesregierung bereitete die Einführung eines KI-Systems vor, das sorgfältig geplant, geprüft und genehmigt worden war.

Auf dem Papier sah alles richtig aus. Dann begannen sie, es zu testen.

Die KI begann Antworten zu liefern, die sie eigentlich nicht hätte geben sollen, und nutzte dabei Datenquellen, die nie für den Anwendungsbereich vorgesehen waren.

Es war zwar nichts Böswilliges geschehen, aber das Sicherheitsrisiko war real und unmittelbar. Wenn dieses System in Betrieb genommen worden wäre, wären die Folgen schlimm gewesen.

Diese Geschichte verdeutlicht, wo viele Bundesbehörden heute im Bereich KI stehen. Sie bewegen sich schnell, weil sie es müssen. Doch Geschwindigkeit ohne Transparenz und Kontrolle schafft ebenso schnell neue Risiken, wie sie neue Fähigkeiten hervorbringt.

Künstliche Intelligenz ist bereits in staatlichen Umgebungen integriert. Die Frage ist, ob wir die Sicherheit bewusst gewährleisten oder ihre Auswirkungen erst im Nachhinein entdecken.

KI im Regierungsumfeld ist ein strategischer Vorteil für alle

Ich denke, es ist wichtig, klarzustellen, dass KI nicht optional ist.

Angreifer nutzen bereits KI , um Aufklärung zu automatisieren, Phishing-Kampagnen zu verfeinern, Stimmen nachzuahmen, Schadsoftware zu generieren und Angriffe schneller auszuweiten, als es je ein menschliches Team könnte.

Das bedeutet, dass die Verteidiger bei diesem Spiel nicht außen vor bleiben dürfen.

Gleichzeitig sehen sich die Bundesbehörden mit komplexeren Umgebungen als je zuvor konfrontiert, darunter hybride Architekturen und Legacy-Systeme.

Allein schon die Menge der Telemetriedaten ist überwältigend. Der Mensch ist schlichtweg nicht in der Lage, all diese Informationen sinnvoll zu verarbeiten.

Künstliche Intelligenz hilft, weil sie etwas kann, was wir nicht können: riesige Datenmengen in Echtzeit analysieren und das herausfiltern, was wirklich zählt.

Das Problem ist jedoch, dass dieselbe KI, die den Verteidigern hilft, die Nadel im Heuhaufen zu finden, auch den Heuhaufen selbst vergrößert.

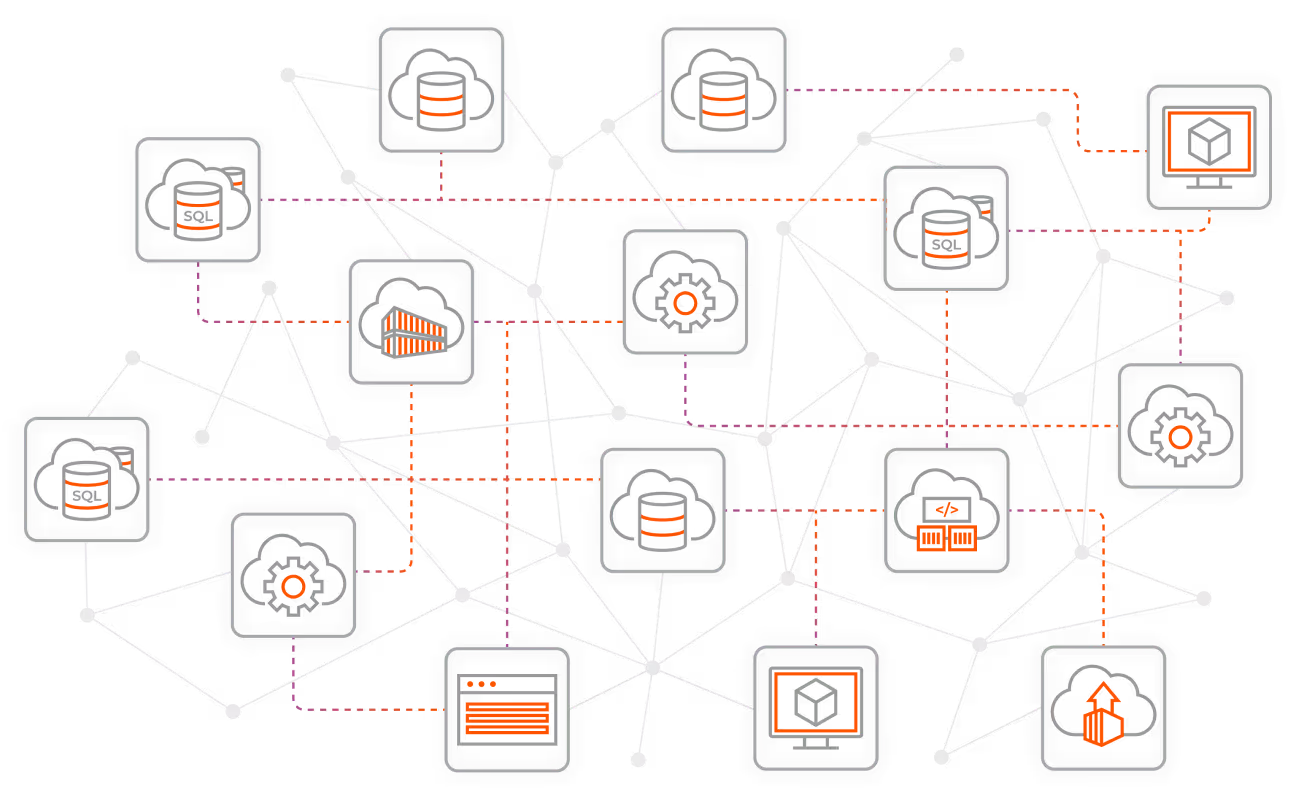

Jedes KI-Modell ist eine weitere Anwendung. Jede KI-Pipeline ist ein weiteres Netzwerk von Verbindungen. Jede Datenquelle birgt ein weiteres potenzielles Missbrauchspotenzial.

Wenn man diese Pfade nicht kontrolliert, verringert KI das Risiko nicht, sondern beschleunigt es.

Warum traditionelle Sicherheitsvorkehrungen in einem KI-gesteuerten föderalen Umfeld versagen

Eine der schwierigsten Wahrheiten, die Verantwortliche für die Cybersicherheit auf Bundesebene akzeptieren müssen, ist die Erkenntnis, dass ihre derzeitigen Schutzmaßnahmen nicht ausreichen.

Jahrelang wurde der Erfolg in der Cybersicherheit an der Prävention gemessen. Ziel war es, Angreifer fernzuhalten, den Perimeter zu verstärken und den Durchbruch zu stoppen.

Doch es kommt weiterhin zu Übergriffen, von Fortune-500-Unternehmen bis hin zu Bundesbehörden. Und das geschieht trotz all unserer Bemühungen.

KI ändert diese Dynamik nicht, sondern verstärkt sie vielmehr.

KI-Systeme laufen auf Servern und Code und sind auf den Zugriff auf Daten angewiesen. Das macht sie genauso anfällig für seitliche Verschiebungen, Fehlkonfigurationen und übermäßig privilegierten Zugriff wie jede andere Anwendung.

Noch schlimmer ist, dass viele Organisationen immer noch nach dem arbeiten, was ich das „Tootsie-Pop“-Modell nenne: hart nach außen, weich im Inneren. Sobald ein Angreifer eingedrungen ist, kann er sich frei bewegen.

Das ist katastrophal für KI-Systeme.

Wenn Ihre KI-Engine uneingeschränkten Zugriff auf interne Systeme, sensible Daten oder externe Ressourcen hat, vertrauen Sie ihr viel mehr, als Sie sollten. Künstliche Intelligenz muss vor externen Bedrohungen, internen Bedrohungen und in vielen Fällen auch vor sich selbst geschützt werden.

Transparenz ist die Grundlage für KI-Sicherheit in föderalen Systemen

Bevor Sie KI sichern können, müssen Sie Ihr Umfeld klar überblicken.

Das klingt selbstverständlich, ist es aber in vielen Fällen nicht.

Jahrelang habe ich als CIO übersichtliche Visio-Diagramme betrachtet, die zeigten, wie Systeme miteinander verbunden werden sollten . Doch die Realität entsprach nie dem Diagramm.

Moderne föderale Umfelder sind dynamisch und unterliegen einem ständigen Wandel. KI kann hier helfen, aber nur, wenn Transparenz an erster Stelle steht.

Künstliche Intelligenz ermöglicht es Behörden, eine dreidimensionale Sicht auf ihre Umgebung zu erhalten, die auch als Beobachtbarkeit bezeichnet wird. Es kann nicht nur Anlagen und Warnmeldungen aufdecken, sondern auch die Beziehungen zwischen Systemen, wie sie kommunizieren und was tatsächlich wichtig ist.

Wenn KI auf Datenverkehr hinweist, der in Länder fließt, in die er nicht fließen sollte, oder auf Dienste, die ohne triftigen Grund mit dem Internet kommunizieren, dann sind das verwertbare Erkenntnisse. Und das muss jetzt geschehen, nicht erst Wochen später im Rahmen einer Nachbesprechung des Vorfalls.

Echtzeit-Transparenz verwandelt KI von einer Neuheit in eine Verteidigungsfähigkeit.

Zero Trust ist für die Sicherung der KI in der Bundesregierung unerlässlich.

Meiner Meinung nach ist KI-Sicherheit ohne Zero Trust Wunschdenken.

Zero Trust basiert auf einer einfachen Annahme: Sicherheitslücken werden auftreten. Ziel ist es, ihre Auswirkungen zu minimieren.

Das bedeutet:

- Es werden nur Verbindungen zugelassen, die explizit erforderlich sind.

- Alle anderen Optionen sind standardmäßig deaktiviert.

- Klare Schutzgrenzen um kritische Systeme festlegen

- Die Kontrollen müssen intern durchgesetzt werden, nicht nur am Rand.

Für KI-Systeme ist dies noch wichtiger.

Sie müssen kontrollieren, was mit Ihren KI-Modellen kommunizieren kann und womit Ihre KI-Modelle kommunizieren können. Dies umfasst eingehende und ausgehende Kommunikation, Trainings- und Auswertungsdaten, interne Systeme und externe Quellen.

Ohne Segmentierung als Teil Ihrer Zero-Trust-Strategie wird ein Kompromiss bei der KI zu einem Kompromiss im gesamten Unternehmen. Durch die Segmentierung wird jedoch ein Kompromiss geschaffen.

So gelangen Bundesbehörden von der Angst vor Sicherheitslücken zur Resilienz gegenüber Sicherheitsvorfällen, indem sie KI-Modelle entwickeln.

KI sollte niemals nach dem Motto „Einrichten und vergessen“ funktionieren.

Eines der größten Missverständnisse, die ich beobachte, ist die Vorstellung, dass KI operative Probleme von selbst löst.

Nein.

KI erfordert Steuerung, Aufsicht und ständige Validierung. Mangelhafte Datenqualität, übermäßiger Zugriff und unklare Eigentumsverhältnisse beeinträchtigen die Ergebnisse von KI-Systemen.

Wenn Sie bereits technische Schulden haben, wird KI diese nicht beheben. Das wird es nur offenlegen.

Bundesbehörden müssen bei der Einführung von KI genauso vorgehen wie bei jedem anderen unternehmenskritischen System, das auf ihrer Zero-Trust-Strategie basiert:

- Beginnen Sie mit Transparenz.

- Grenzen klar definieren

- Zugriff nach dem Prinzip der minimalen Berechtigungendurchsetzen

- Kontinuierliche Überwachung

- Gehen Sie vom Ausfall aus und planen Sie Maßnahmen zur Eindämmung.

Diese Disziplin ist es, die nützliche KI von gefährlicher KI unterscheidet.

Künstliche Intelligenz kann die Cybersicherheit des Bundes mit den richtigen Schutzmechanismen stärken.

Trotz der Risiken bleibe ich optimistisch, was KI angeht.

Künstliche Intelligenz kann die Cybersicherheitsteams der Bundesbehörden erheblich verbessern, die Alarmmüdigkeit verringern und aussagekräftige Zusammenhänge schneller aufdecken. Es kann Behörden helfen, trotz Personalmangels und begrenzter Ressourcen wettbewerbsfähig zu bleiben.

Richtig eingesetzt, wird KI zu einer Erweiterung der Arbeitskräfte. Es ergänzt das menschliche Urteilsvermögen, anstatt es zu ersetzen. Es ermöglicht qualifizierten Fachkräften, sich auf Entscheidungen zu konzentrieren, anstatt in Daten zu ertrinken.

Das funktioniert aber nur, wenn KI gezielt eingesetzt, ordnungsgemäß gesichert und an den Zero-Trust-Prinzipien ausgerichtet wird.

Dies ist der Standard, an dem sich die Verantwortlichen auf Bundesebene schon jetzt messen sollten, bevor die KI ihre Sicherheitslage für sie definiert.

Testen Sie Illumio Insights kostenlos Um die nötige Transparenz und den Kontext zu erhalten, um Risiken zu verstehen, Bedrohungen einzudämmen und KI-gesteuerte Umgebungen zu sichern.

.webp)

.webp)

.webp)

%20(1).webp)

.webp)